Alejandro Urueña

Ética e Inteligencia Artificial (IA) - Founder & CEO Clever Hans Diseño de Arquitectura y Soluciones en Inteligencia Artificial. Magister en Inteligencia Artificial.

María S. Taboada

Lingüista y Magíster en Psicología Social. Profesora Titular de “Linguística General I” y “Política y Planificación Linguísticas” de la Fac. de Filosofía y Letras de la UNT.

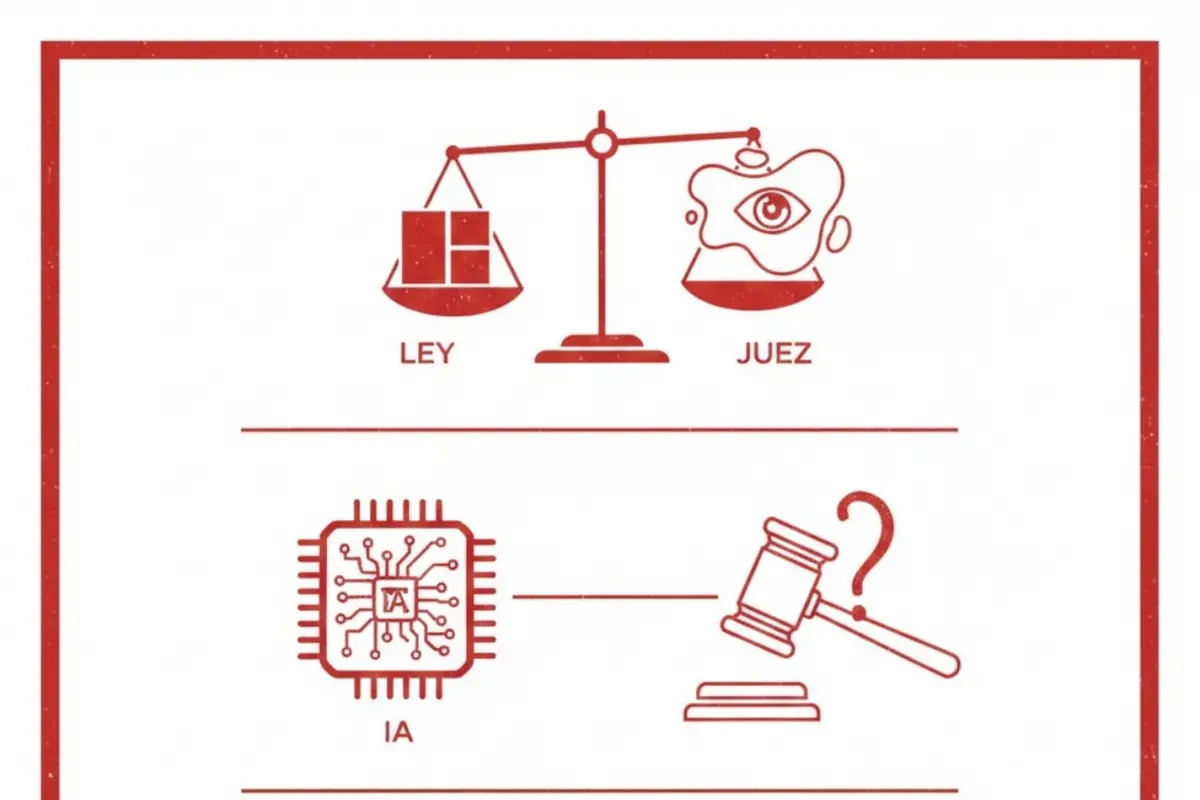

Un estudio experimental recién publicado por la Universidad de Chicago, titulado Silicon Formalism, puso a 61 jueces federales estadounidenses y a GPT-5, el modelo de inteligencia artificial más avanzado de OpenAI, a resolver el mismo caso hipotético de daños por un accidente automovilístico. El diseño manipuló simultáneamente tres variables: el foro del juicio (Wyoming, cuya ley de conflictos es una regla rígida que manda aplicar la ley del lugar del accidente, o South Dakota, cuya ley es un estándar flexible que pide ponderar cuál estado tiene la “relación más significativa” con el caso), la ubicación del accidente, y el grado de simpatía de las partes. Ocho combinaciones posibles, doscientas corridas para la IA, y un resultado que los autores presentan como contundente: los jueces siguieron la ley correctamente apenas el 52% de las veces, mientras que GPT-5 acertó el 100%, sin un solo error. De ahí el paper concluye que la IA es más “formalista” que los jueces humanos. Pero la pregunta que deberíamos hacernos antes de aplaudir no es si la máquina acierta más, sino qué está midiendo realmente este experimento y qué se entiende por “acertar” en un campo como el derecho.

Aquí es donde el estudio revela su falla más profunda, y es de orden epistemológico: trata al derecho como si fuera matemática formal, donde hay una única respuesta correcta y cualquier desviación es un error. Pero el derecho no funciona así. La aplicación del derecho, y particularmente la jurisprudencia, implica por definición una dinámica entre formalismo y estándares abiertos. Un juez no es una calculadora que ingresa hechos y escupe resultados; es un intérprete que pondera principios, sopesa contextos y ejerce un criterio que la propia ley le manda ejercer. De hecho, los propios autores reconocen en la Sección 6 del paper que el estándar de South Dakota, basado en el Restatement Second, no necesariamente obliga a un único resultado, y que la jurisprudencia citada en los materiales del experimento permite al juez apartarse del domicilio común por múltiples razones, incluyendo la evaluación de cuál estado tiene la “mejor ley”. Entonces, si los propios investigadores admiten que no están seguros de que las desviaciones judiciales sean verdaderos errores, ¿cómo pueden al mismo tiempo proclamar que la IA “sigue la ley” mejor que los jueces? Lo que en realidad midieron no es qué tan bien juzgan los jueces, sino qué tan bien replica una máquina la lectura más literal y mecánica de una doctrina jurídica.

Esto nos lleva al segundo problema fundamental: lo que el estudio presenta como virtud de la IA, su formalismo perfecto, es en realidad un sesgo algorítmico. Los modelos más avanzados, como GPT-5 y Gemini 3 Pro, tienden fuertemente al formalismo, pero ni siquiera eso es uniforme: el propio estudio muestra que modelos menos avanzados como Llama 4 Scout acertaron apenas el 50%, igual que los jueces, y que otros como Llama 4 Maverick replicaron la aversión humana a los topes de daños, como si hubieran absorbido ese sesgo de los textos jurídicos con los que fueron entrenados. Es decir, cuando la IA “falla”, falla exactamente como un humano, y cuando “acierta”, lo hace porque reproduce la lectura más literal y mecánica del texto normativo, sin capacidad de ponderar valores en tensión ni integrar la dimensión cualitativa que la aplicación del derecho requiere. Cuando GPT-5 aplica el tope de daños de Kansas sin pestañear, no está “siguiendo la ley mejor” que un juez que decide no aplicarlo; está haciendo lo que su arquitectura privilegia: reproducir el patrón formalista dominante en sus datos de entrenamiento. Mientras tanto, el juez que se desvía podría estar ejerciendo exactamente la función que el sistema jurídico le asigna: interpretar, contextualizar y hacer justicia dentro del margen que la propia ley le otorga. Catorce Cortes Supremas estaduales, como documenta el propio estudio, han declarado inconstitucionales los topes de daños no económicos. La aversión judicial a esos topes no es un capricho: responde a una tradición jurídica consolidada que cuestiona su legitimidad.

A esto se suma un problema metodológico serio: el estudio cruza arbitrariamente una lógica cuantitativa con un objeto irreductiblemente cualitativo. Medir la “correctitud” de una decisión judicial en términos de porcentaje de aciertos, como quien mide la precisión de un tirador en una galería de tiro, presupone que existe un blanco fijo. Pero en el derecho el blanco se mueve, y se mueve legítimamente. La confrontación experimental entre reglas y estándares como si fueran dos opciones equivalentes en un diseño factorial ignora que, en la práctica judicial real, la tensión entre ambos es constitutiva del razonamiento jurídico, no una variable aislable. Un juez que opera bajo un estándar no “yerra” porque llega a un resultado distinto al del domicilio común; está haciendo lo que el estándar le pide: ponderar. Reducir esa ponderación a un código binario de acierto o error para poder compararlo con la salida de un algoritmo es, en el mejor de los casos, una simplificación excesiva y, en el peor, un montaje que garantiza de antemano la “victoria” de la IA.

Lo que verdaderamente debería preocuparnos no es si un robot aplica reglas mejor que un juez, sino las representaciones sociales que estudios como este refuerzan sobre qué es el derecho. Es cierto que Posner y Saran matizan sus propias conclusiones y reconocen que las desviaciones judiciales pueden no ser errores. Pero cuando el título del paper habla de “formalismo de silicio”, cuando las figuras muestran barras del 100% contra barras del 52%, y cuando la conclusión afirma que la dirección evolutiva de la IA apunta hacia una “lealtad sin errores al formalismo”, el mensaje que queda instalado en el imaginario colectivo es que la ley se aplica “al pie de la letra” como quien sigue una receta de cocina, y que cualquier desviación es una falla del sistema. Esa representación es peligrosa. El derecho no es un código binario; es un campo de tensión entre la norma escrita, los principios constitucionales, la jurisprudencia, los derechos fundamentales y la realidad concreta de las personas que están siendo juzgadas. Que un juez considere injusto privar a una víctima gravemente herida de una compensación adecuada no es un “error” comparable al de una máquina que confunde una fecha; es una expresión del mandato constitucional de hacer justicia.

Nada de esto significa que la inteligencia artificial no tenga un lugar valioso en el campo jurídico. Puede ser una herramienta extraordinaria para sistematizar información, detectar patrones, acelerar tareas mecánicas y asistir a los operadores del derecho. Pero presentarla como un juez “superior” porque nunca se desvía de la lectura literal de una norma es no entender para qué existe un juez en primer lugar. La función judicial no es recitar la ley; es interpretarla, ponderarla y aplicarla en un contexto humano concreto. Eso requiere criterio, y el criterio, por definición, admite variación. El verdadero hallazgo de Silicon Formalism no es que la IA sea mejor juez que un humano. Es que, si le pedimos a una máquina que juegue un juego cuyas reglas fueron diseñadas para que ella gane, va a ganar. La pregunta crítica no es si el robot acierta más, sino si lo que el robot hace cuando “acierta” puede llamarse, en algún sentido serio, juzgar.

Fuente: Silicon Formalism: Rules, Standards, and Judge AI - Posner & Saran, University of Chicago Law School, enero 2026