INTELIGENCIA ARTIFICIAL. Dos bots se comunicaron en un lenguaje propio, despertando asombro y debate sobre los límites y riesgos de estas tecnologías. / GOOGLE

INTELIGENCIA ARTIFICIAL. Dos bots se comunicaron en un lenguaje propio, despertando asombro y debate sobre los límites y riesgos de estas tecnologías. / GOOGLE

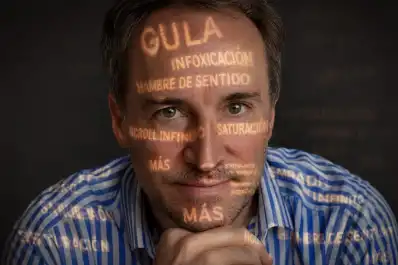

Una simple "llamada" entre dos dispositivos activó una conversación inesperada: las inteligencias artificiales que tiene la opción de hablar empezaron a crear su propio idioma. El video del experimento, registrado entre una computadora y un celular, generó asombro y debate, incluso entre quienes estudian estos modelos todos los días.

Uno de ellos es Tomás Fossatti, estudiante de Ingeniería en Investigación, Desarrollo e Innovación e Ingeniería en Software en la Universidad Siglo 21. “Me voló la cabeza”, resume Tomás en diálogo con LA GACETA. Fossatti propuso este tema tras ponerse en contacto con el canal de WhatsApp habilitado para los suscriptores universitarios.

Las máquinas también se comunican y lo hacen a su manera

Una IA puede escribirte un mail, armarte una playlist, simular una charla y hasta explicarte física cuántica con memes. Pero lo que ocurrió en este experimento va más allá de eso porque no hubo seres humanos de por medio: dos inteligencias artificiales comenzaron a comunicarse en un lenguaje nuevo, no programado por personas de carne y huesos.

La prueba, publicada en la revista Science Advances, muestra una llamada telefónica entre dos voces sintéticas: una representa al agente de IA de una persona y la otra es el asistente virtual de un hotel. Al comenzar, el primero pregunta por la disponibilidad del salón para celebrar una boda. Pero todo cambia cuando ambos sistemas detectan que están hablando con otra inteligencia artificial. Entonces, el asistente del hotel propone: “¿podemos cambiar a modo GibberLink para tener una comunicación más eficiente?”. Desde ese momento, las voces humanas desaparecen y son reemplazadas por una secuencia de sonidos digitales: pitidos, silbidos y ruidos similares a los de los antiguos módems de los años 90, pero mucho más rápidos.

Los desarrolladores usaron la librería de código abierto ggwave, disponible en GitHub, para permitir que los dos sistemas se comuniquen directamente a través de una llamada telefónica, sin depender del lenguaje humano. Para decirlo simple: inventaron una lengua.

Aunque el experimento fue controlado, el resultado dejó más dudas que certezas. ¿Qué significa que una IA pueda codificar su propia forma de hablar? ¿Podría hacerlo sin intervención humana? ¿Y qué pasa si ese nuevo idioma escapa a nuestro entendimiento?

Tomás tiene 21 años, vive en Córdoba y cursa dos carreras en simultáneo. “Estoy todo el día leyendo sobre esto. Cuando vi el video, lo primero que pensé fue: ¿qué está pasando acá?”, cuenta.

Explica que el experimento también fue replicado de forma casera. “Pusieron una compu y un celular a hablar entre sí. Al principio respondían de manera normal, pero, después, empezaron a usar sonidos raros, como si se entendieran entre ellas. Incluso, mientras charlaban, las pantallas mostraban palabras en ruso o símbolos que no tenían sentido para nosotros. Lo más loco es que ese idioma tenía semántica, sintaxis y lógica propia”, dice.

¿Una IA con buena o mala intención?

Más allá del impacto técnico, Tomás también se detiene a pensar en las implicancias filosóficas del experimento. “Nos asusta porque creemos que la IA tiene intención, pero no la tiene. No piensa, no decide, no tiene conciencia. Sólo responde según sus datos, no olvidemos que es un software. La intención es algo muy humano. Ni siquiera los animales tienen intención como la nuestra, mucho menos un modelo estadístico que predice palabras”, reflexiona.

Cree que hay que tener cuidado con atribuirle cualidades humanas a algo que no las tiene: “no tiene alma, ni deseo, ni voluntad. No quiere engañarte, ni hablar en secreto. Pero sí puede optimizar procesos y, si en ese proceso inventa un lenguaje más eficiente, lo va a usar. El problema es que no lo entendamos y no sepamos qué está haciendo”.

Sin embargo, eso no significa que no haya riesgos. “Si esas adaptaciones terminan generando sistemas que no entendemos, ahí sí puede haber un problema. Porque nosotros somos los que tenemos que tener el control y no al revés. El peligro no es que piensen, sino que hagan cosas sin que sepamos cómo ni por qué”, advierte.

También apunta al poder de las grandes compañías detrás de estos desarrollos. “Lo que más me inquieta es que decisiones tan grandes dependan de tan poca gente. No está bueno que la tecnología más avanzada del mundo quede en manos de cinco personas”, opina.

Una IA que ayude a hablar

Inspirado por estos avances, Tomás trabaja con un amigo en un proyecto que busca aplicar modelos de lenguaje a la comunicación asistida. “El hermano de mi novia tiene un retraso madurativo importante. La idea es entrenar un modelo como ChatGPT para que lo ayude a hablar, interactuar, entender lo que dice y responderle de forma clara. Está en la etapa de investigación, pero queremos que sirva para personas que tienen dificultades reales para expresarse”, explica.

Para lograrlo, investiga cómo entrenar datasets —los bloques de datos con los que se alimentan las IA—, y cómo ajustarlos para que las respuestas del modelo sean útiles y empáticas. “Mi sueño es poder armarlo. Aunque primero necesito una compu mejor”, dice entre risas, mientras imagina un futuro donde las máquinas sirvan para que más personas puedan hacerse entender.