Alejandro Urueña

Ética e Inteligencia Artificial (IA) - Founder & CEO Clever Hans Diseño de Arquitectura y Soluciones en Inteligencia Artificial. Magister en Inteligencia Artificial.

María S. Taboada

Lingüista y Magíster en Psicología Social. Profesora Titular de “Linguística General I” y “Política y Planificación Linguísticas” de la Fac. de Filosofía y Letras de la UNT.

Cuando preguntamos algo a los largos Modelos de Lenguaje y recibimos una respuesta coherente, cuando un sistema predice si un crédito será pagado o no, cuando una aplicación reconoce una cara en una foto, lo que vemos es un resultado. Un producto final. Una respuesta que parece surgir de algún tipo de inteligencia. Pero ese resultado tiene un back, un proceso de producción tan mecánico como el de una fábrica de galletitas. La diferencia es que nadie nos mostró nunca esa cocina. Y mientras no la veamos, seguiremos atribuyendo a estas máquinas capacidades que no tienen: comprensión, criterio, pensamiento. Desmitificar la inteligencia artificial no es un capricho intelectual; es la única forma de usar estas herramientas sin ser víctima de sus limitaciones. Porque la IAno piensa. Multiplica. Y entender esa multiplicación es entender qué podemos pedirle y qué no.

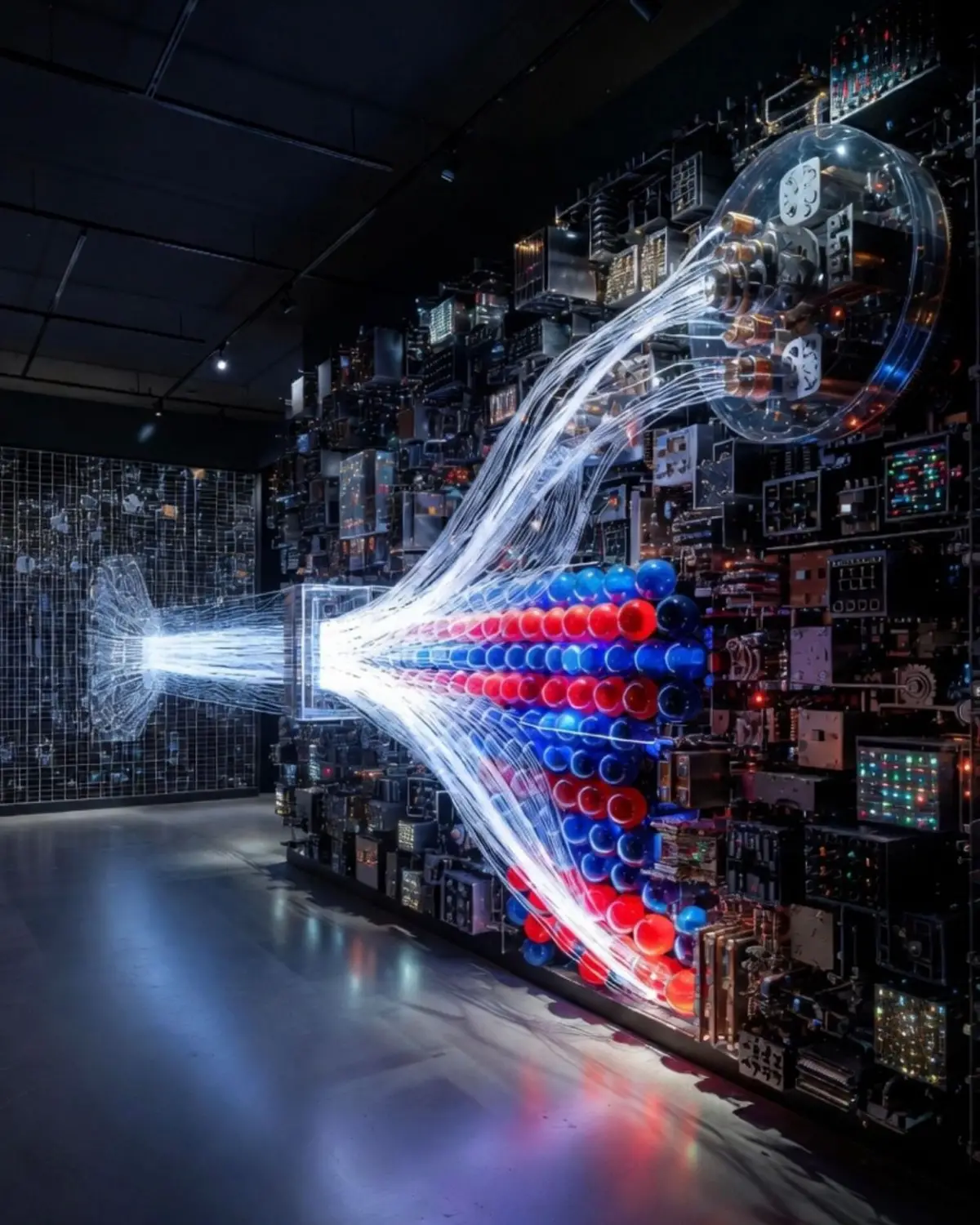

El corazón de la inteligencia artificial moderna es algo llamado “red neuronal”, un nombre que sugiere cerebros digitales y sinapsis artificiales. La realidad es menos romántica. Imaginemos un chef que recibe ingredientes y debe decidir si el plato está listo. El tomate entra con valor 3, la cebolla con valor 2, el ajo con valor 4. El chef multiplica cada ingrediente por un “peso” según su receta secreta: tomate por 0.5, cebolla por 0.3, ajo por 0.8. Suma todo: 1.5 + 0.6 + 3.2 = 5.3. Si el resultado supera 5, el plato se aprueba. Eso es exactamente lo que hace una neurona artificial: recibe números, los multiplica por pesos, suma, y decide si pasa o no pasa. Una red neuronal son miles de estos chefs trabajando en cadena. El primero evalúa ingredientes crudos, pasa su resultado al segundo que evalúa combinaciones, que pasa al tercero que evalúa sabores complejos. El resultado final que vemos, esa respuesta “inteligente”, es el producto de esta cadena de multiplicaciones. No hay comprensión en ningún eslabón.

Entrenamiento

Pero, ¿de dónde salen esos “pesos” que multiplican cada entrada? Acá entra el proceso de entrenamiento, que suena a educación pero funciona como calibración industrial. Imaginemos que nuestro chef cocina el mismo plato un millón de veces. Cada vez que lo sirve, recibe una crítica: “muy salado”, “le falta cocción”, “perfecto”. Un asistente invisible calcula exactamente cuánto debe ajustar cada proporción para que la próxima crítica sea mejor. Si el tomate estaba en 0.5 y el plato salió salado, quizás debe bajar a 0.48. Esto se llama “backpropagation” o propagación hacia atrás: el error se mide, y se ajustan todos los pesos un poquito para reducirlo. Repetido billones de veces, este proceso produce los millones de números que llamamos “el modelo entrenado”. El chef nunca “entendió” qué es un buen plato. Simplemente ajustó proporciones hasta minimizar quejas. El “conocimiento” de la IA son esos números guardados en un archivo. Cuando ChatGPT, Claude u otros modelos de lenguaje parecen saber algo, significa que sus pesos están calibrados para producir ciertas palabras ante ciertos estímulos. No hay conocimiento en el sentido humano: comprensión, interpretación crítica en cotejo con multiplicidad de conocimientos previos surgidos de la experiencia, los aprendizajes, las relaciones con los otros, las decisiones. No hay conciencia ni autodeterminación. Hay configuración numérica.

Otro proceso fundamental, usado para clasificar datos, se llama Support Vector Machine o SVM. Supongamos que tenemos datos de miles de clientes bancarios: algunos pagaron sus créditos, otros no. Cada cliente tiene características: edad, ingreso, historial. El SVM tiene una única misión: encontrar la línea que mejor separe pagadores de morosos. No “analiza” cada cliente; busca dónde cortar el espacio para que la mayoría de los buenos queden de un lado y los malos del otro. Es como un portero de boliche que no evalúa a cada persona individualmente, sino que define una regla general: “mayores de 25 con camisa pasan, el resto no”. Los únicos clientes que realmente importan son los que quedan justo en el borde de la decisión, llamados “vectores de soporte”. Si tenemos 100.000 clientes pero solo 500 están cerca del límite, el modelo se define únicamente por esos 500. El resto podría desaparecer y la clasificación sería idéntica (Destrucción de posibilidades y oportunidades). Cuando un banco dice que la IA “analizó” tu solicitud de crédito, lo que hizo fue ubicarte de un lado u otro de una línea matemática.

Pero, ¿qué pasa cuando los datos están tan mezclados que ninguna línea recta puede separarlos? Imaginemos bolitas rojas en el centro de una mesa y bolitas azules alrededor formando un círculo. Imposible trazar una línea recta que las separe. La solución teórica sería agregar una tercera dimensión: elevar cada bolita según qué tan lejos está del centro. Las rojas del centro suben poco, las azules del borde suben mucho. Ahora sí podemos pasar un plano horizontal entre ellas. El problema es que hacer esta transformación con millones de datos en miles de dimensiones requeriría más computación de la que existe en el planeta. Acá entra el “kernel trick”, que es exactamente lo que su nombre indica: un truco. Una función matemática que calcula el resultado de la transformación sin hacerla. Es como saber cuánto costaría construir un edificio sin hacer los planos: obtenés el número final a través de un atajo algebraico. La IA no “entiende” la complejidad de los datos; encontró una forma de fingir que los transformó cuando en realidad solo aplicó una fórmula.

Cuando la IA no clasifica sino que predice números concretos, como el precio futuro de una acción o la altura del río mañana, usa una variante llamada Support Vector Regression. La mecánica es fascinante por su simplicidad brutal. Imaginemos una víbora, un tubo flexible que viaja por los datos intentando contener la mayor cantidad posible dentro de su diámetro. Si el tubo tiene un ancho de 7%, significa que aceptamos predicciones que se equivoquen hasta 7%. Los puntos dentro del tubo no generan error; solo penalizamos los que quedan afuera. El objetivo es encontrar la víbora más angosta posible que contenga la mayor cantidad de datos. Cuando un sistema predice que “el dólar estará a $1.050 con 95% de confianza”, lo que hizo fue trazar este tubo por datos históricos y proyectarlo. No analizó la economía, no consideró factores geopolíticos, no tiene intuición de mercado. Encontró un patrón estadístico y lo extendió. Si mañana ocurre algo que nunca ocurrió antes, el tubo no lo sabe. Solo replica lo que vio.

Una distinción crucial que separa a quienes usan IA con discernimiento crítico de quienes la usan a ciegas es entender qué decide el humano y qué decide la máquina. Los “hiperparámetros” son decisiones humanas antes del entrenamiento: qué tan ancho es el tubo de tolerancia, qué tan estrictos somos con los errores, cuántas capas tiene la red, qué tipo de transformación aplicamos. Son como decidir el tamaño del horno y la temperatura antes de cocinar. Las “variables” o “parámetros aprendidos” son los millones de pesos que el algoritmo ajusta solo durante el entrenamiento: las proporciones exactas de la receta descubiertas por prueba y error. Cuando una IA falla, rara vez es porque “se equivocó”. Es porque un humano eligió mal los hiperparámetros, o porque los datos de entrenamiento tenían sesgos, o porque el problema no era apto para ese tipo de modelo o no tenía los datos para responderlos. La responsabilidad siempre es humana. La máquina solo optimiza números dentro de las restricciones que le dimos. Si le dimos restricciones incorrectas, producirá resultados incorrectos con la misma eficiencia con la que produciría resultados correctos.

Sin criterio ni pensamiento

El resultado que vemos en pantalla, esa respuesta que parece inteligente, ese porcentaje de probabilidad, esa predicción numérica, es el producto final de este proceso: datos convertidos en números, mediante (Vectores y Embeddings) según el modelo; números multiplicados por pesos; pesos ajustados por billones de iteraciones; transformaciones simuladas por trucos algebraicos, todo ejecutado a velocidades que superan la comprensión humana. No hay pensamiento. No hay comprensión. No hay criterio. Hay detección de patrones estadísticos en datos históricos y replicación de esos patrones ante datos nuevos. Si los datos históricos tenían sesgos, el modelo tendrá sesgos. Si los datos históricos no contemplaban una situación nueva, el modelo no podrá manejarla. La IA es extraordinariamente útil para procesar volúmenes de información imposibles para humanos, para encontrar correlaciones invisibles al ojo, para automatizar decisiones repetitivas. Pero solo si entendemos que detrás de la magia aparente hay una fábrica de multiplicaciones. Desmitificarla no la hace menos útil. La hace usable con criterio. Y en un mundo donde estas herramientas definirán cada vez más las decisiones importantes, el criterio no es opcional. Es obligatorio. Porque la única magia peligrosa es la que no se entiende.